Codex 核心技术原理解析:OpenAI 是如何让 AI 真正在你的 Mac 上“动”起来的

当 OpenAI 带着 Codex for (almost) everything(Codex 几乎能做一切) 的重磅更新亮相时,整个科技圈都不由得为之一振。我们早就习惯了 AI 帮我们写代码、回邮件,但官方那句“通过看屏幕、点击和打字,用它自己的光标来操控 macOS”,宣告了一个完全不同量级的新物种的诞生。

作为工程师,我们心里很清楚:想要打通云端大语言模型和本地操作系统,难度有多高。过去几十年里,所谓的“自动化”无非是依赖那些死板的应用程序接口 (API),或者是写一些极其脆弱的 DOM 抓取脚本——只要网页的 UI 稍微改一点,这些脚本瞬间就会崩溃。

那么,这次的核心突破到底是什么?结论就是:Codex 彻底抛弃了代码层面的集成,转向了像素级别的执行。 通过将多模态视觉技术与底层的内核事件注入相结合,OpenAI 直接把图形用户界面 (GUI) 变成了终极的、通用的 API。

让我们抛开那些营销词汇,以硬核的技术视角,扒一扒到底需要怎样的工程架构,才能让 Codex 真正上手“开”动一台 Mac 电脑。

Mac 原生智能体的技术架构

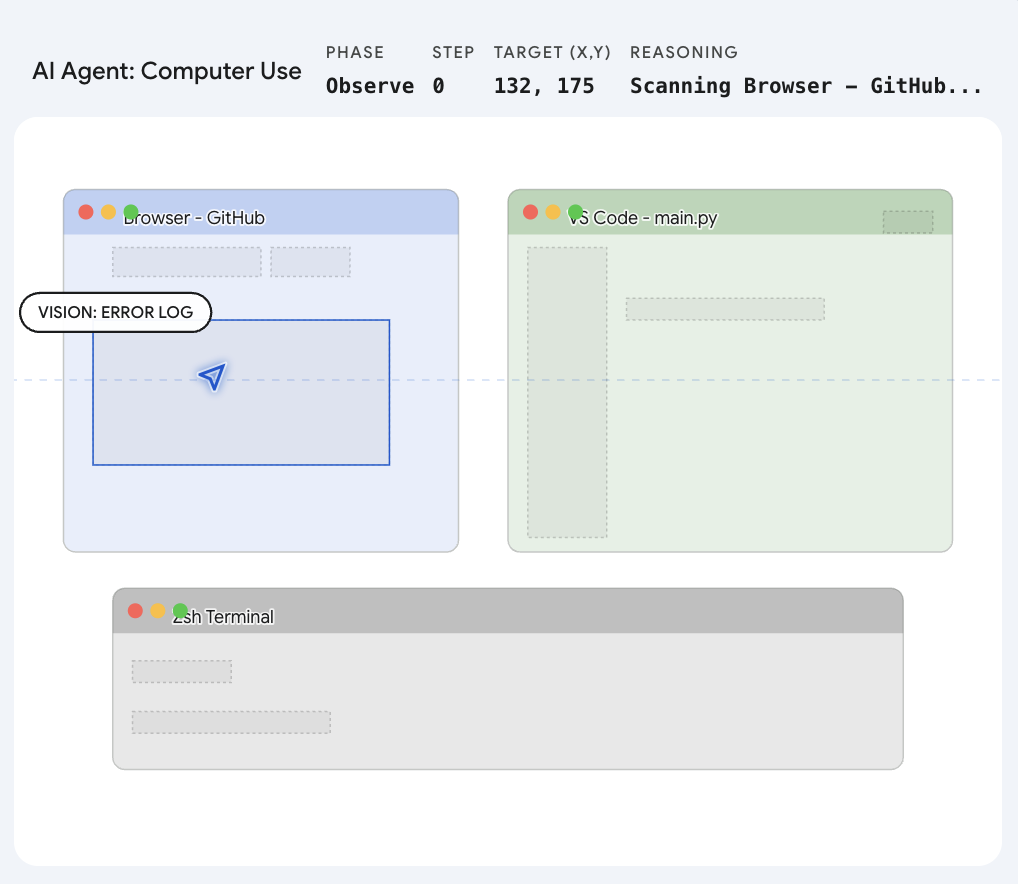

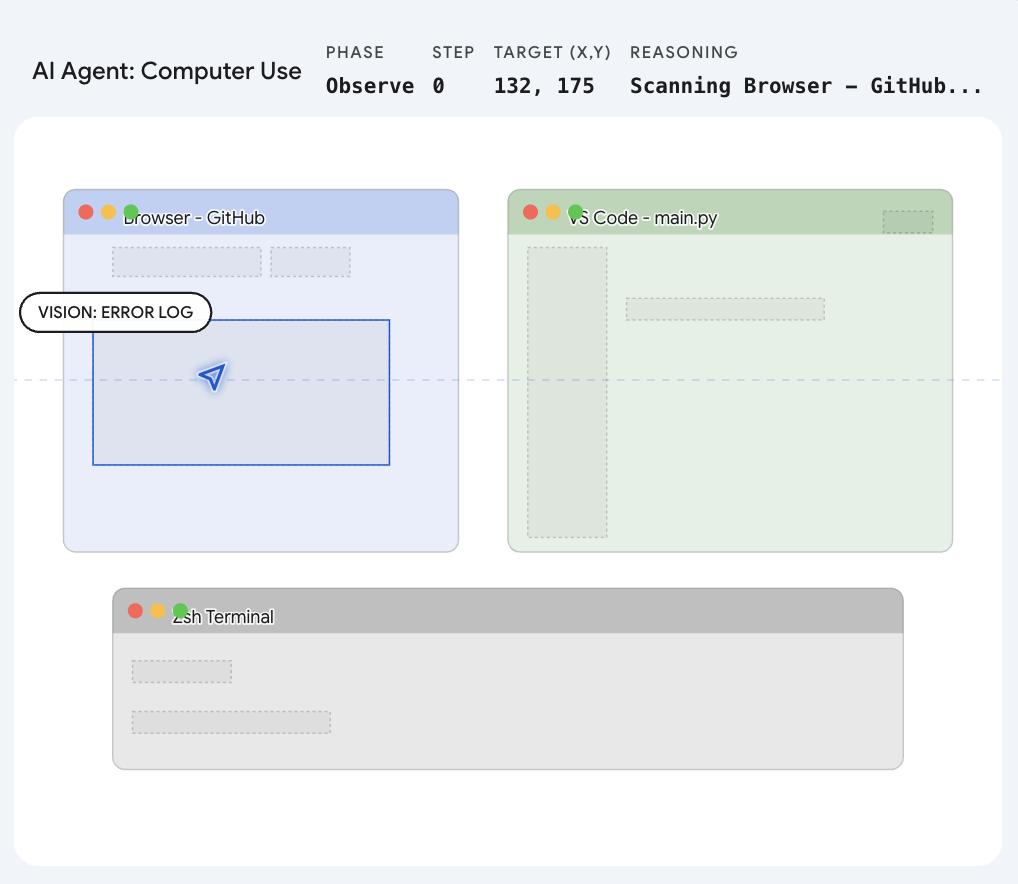

想让 AI 在没有人类干预的情况下,顺利完成 App 测试或者前端界面的迭代,它就必须掌握一个闭环:感知(Perceive)、推理(Reason)、行动(Act)。以下是我们推测的 Codex 在 macOS 上的具体技术实现逻辑。

1. 感知层:语义视觉与“定位引擎 (Grounding)”

像 AppleScript 这类传统的自动化工具,通常是去读取系统的 UI 辅助功能树 (Accessibility Tree)。这招虽然快,但一旦遇到非原生的 Electron 应用、网页 Canvas 画布或者游戏界面(这些地方的 UI 元素根本没有被打上标准标签),它就彻底瞎了。

OpenAI 在文章中明确强调,Codex 是通过“看(seeing)”来使用软件的。这就意味着它用的是计算机视觉 (Computer Vision)技术。运行在你 Mac 上的宿主程序,会以极高的频率对桌面进行截图(帧抓取)。随后,多模态模型会利用语义分割技术来解析这些图像。它不再去寻找底层的 HTML 标签,而是靠眼睛去“认”出一个“提交”按钮或“搜索”框的长相和上下文。

这里真正的工程魔法叫做“定位 (Grounding)”。一旦 AI 决定要点击那个按钮,它就会进行数学计算,把这个语义目标映射为你屏幕上的精确坐标。它能把“点击那个红色的关闭图标”这句指令,翻译成目标像素的 (x, y) 坐标,并且还能自适应你当前屏幕的分辨率和缩放比例。

2. 执行层:注入操作系统级事件

光知道点哪里没用,你得能真正“扣动扳机”。一段软件代码是怎么移动鼠标指针的呢?

答案是:直接绕过物理硬件。为了在原生层面和 macOS 交互,Codex 几乎可以肯定调用了苹果最底层的系统框架,尤其是 Quartz Event Services 和 辅助功能 API (Accessibility API)。

当 Codex 决定点击时,它会伪造一个虚拟的 CGEvent(比如先来一个 mouseDown 鼠标按下,紧接着一个 mouseUp 鼠标抬起),然后把这个事件直接粗暴地塞进 macOS 的系统事件队列里。站在操作系统的上帝视角来看,这个合成事件和你亲手按下妙控板产生的物理信号没有任何区别。这就是为什么 Codex 能够操作任何软件——只要这玩意儿能用鼠标点,Codex 就能点。

3. 隔离层:“幽灵光标”的幕后机制

在官方推文中,技术上最让人拍案叫绝的一点是:Codex 能够“在后台运行且不会接管你的电脑”。用过“按键精灵”这类宏录制工具的人都知道,脚本一跑起来,你的鼠标就被强行绑架了。

为了实现这种并发执行,系统必须将 AI 的输入与用户的物理输入隔离开来。OpenAI 极有可能采用了以下两种方式之一来实现:

- 特定窗口事件路由: macOS 允许开发者将事件直接发送给特定的进程标识符 (PID)。Codex 可能是锁定了目标窗口,然后把伪造的点击事件直接投递到那个应用程序的事件循环中,从而彻底绕开了全局的物理光标。

- 虚拟帧缓冲区 (Virtual Framebuffers): 系统也可能在底层生成了一个“无头 (headless)”的虚拟桌面层。Codex 在这个肉眼看不见的平行空间里“看”着屏幕并进行操作,比如操控浏览器或跑测试;而你依然可以在你的主屏幕上安安静静地打字,互不干扰。这与 Anthropic 前阵子发布的 Computer Use (计算机控制) 功能背后的机制不谋而合。

总结与展望:迈入“后 API 时代”

虽说这些底层技术实现已经足够迷人,但真正让这一刻成为分水岭的,是它带来的巨大行业震荡。

通过在操作系统的原生层面上打通“视觉感知-执行动作”的管道,OpenAI 实际上已经让传统的 API 变成了“可选项”。我们正在大步迈入大型动作模型 (LAM)的时代。如果一个老掉牙的企业内网系统没有 API 接口,Codex 根本不在乎——它会直接像人一样,手动把数据复制粘贴出来。如果某个平台对开发者限制了访问权限,Codex 也会直接打开网页浏览器,像普通用户一样去点击操作。

过去几十年,整个软件行业都在费尽心机地想让各个应用程序“互相说话”。而现在,随着 Codex 彻底征服了 macOS 的图形界面,我们不再需要让软件之间去对话了。我们只需要让 AI 替我们去“用”它们就好了。

作者

Zelon

独立开发者我是一名独立开发者,专注于构建 iOS 和 Web 应用程序,致力于打造实用的 SaaS 产品。我擅长 AI SEO,不断探索智能技术如何推动可持续增长和效率提升。